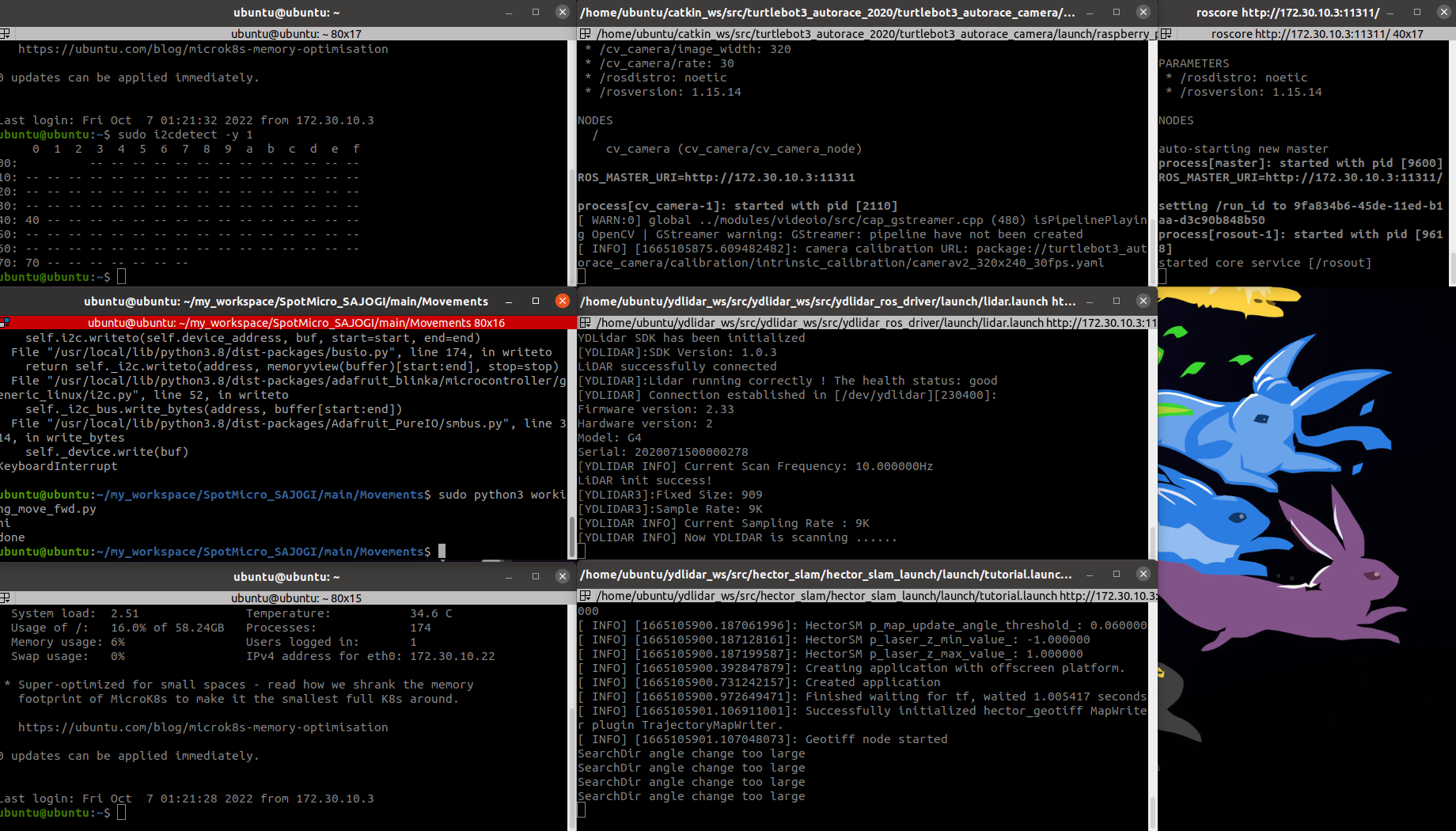

기존 M1 기체 기반으로 개발한 보행 코드와 최근 ROS 기반으로 설정한 카메라, 라이다를 동시에 실행 가능한 지 확인해보았다. 사용한 하드웨어는 다음과 같다.

- Raspberry Pi 4B + Ubuntu Core 20.04

- YD LiDAR G4

- YR019 camera

- Adafruit PCA9685 + dm-cls400md * 12

코드는 아래 git repository에 있다.

GitHub - wkdalswns0427/SpotMicro_SAJOGI: 연세대학교 로보인 Spot Micro 프로젝트

연세대학교 로보인 Spot Micro 프로젝트. Contribute to wkdalswns0427/SpotMicro_SAJOGI development by creating an account on GitHub.

github.com

git clone https://github.com/wkdalswns0427/SpotMicro_SAJOGI.git

sudo python3 SpotMicro_SAJOGI/main/Movements/spot_move_fwd_v1.py

# i2c 드라이버 접근 때문에 sudo 권한으로 실행해야 함기체를 움직이기 전에 두 roslaunch 파일과 하나의 python 파일 실행부터 확인한다.

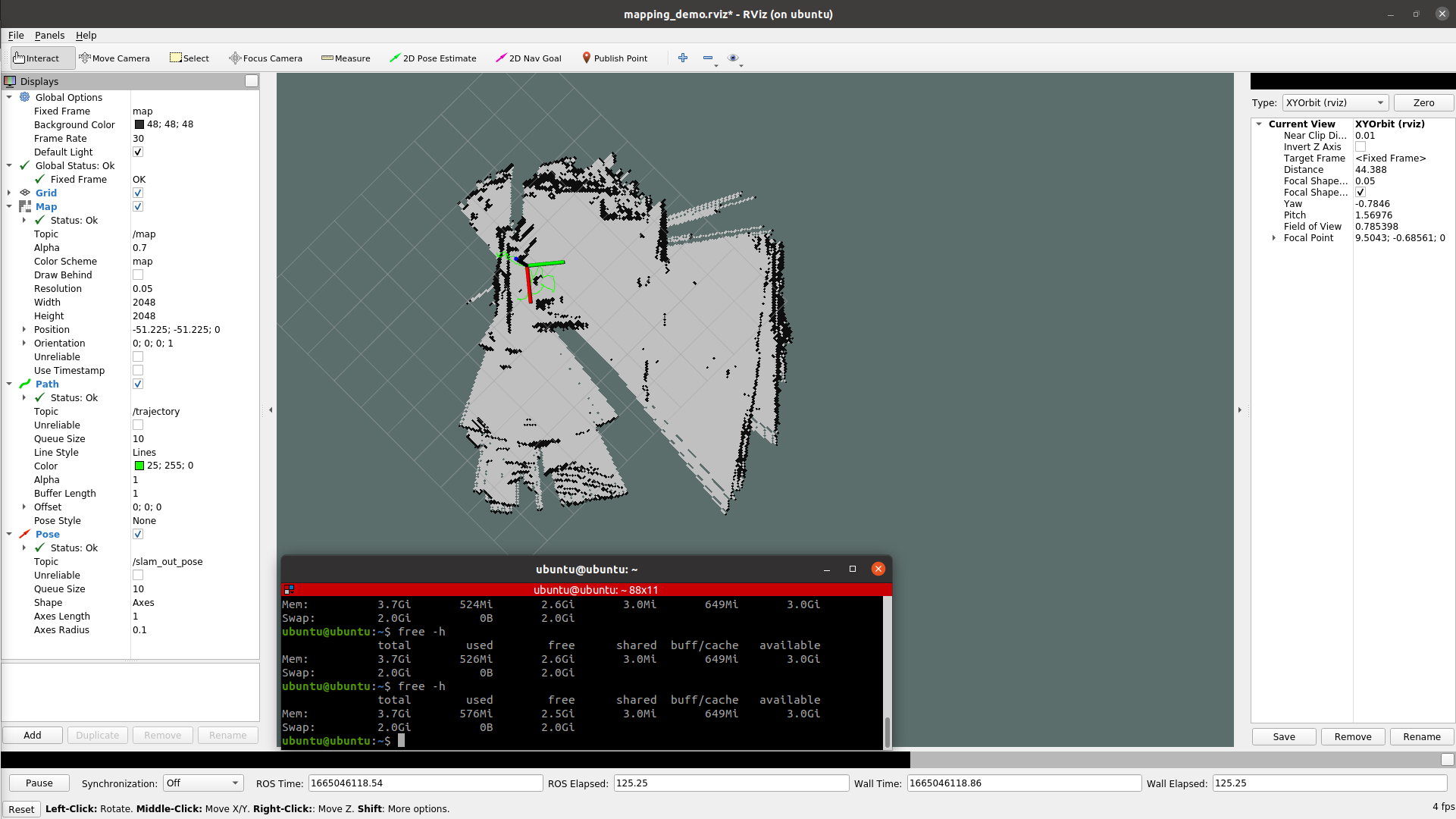

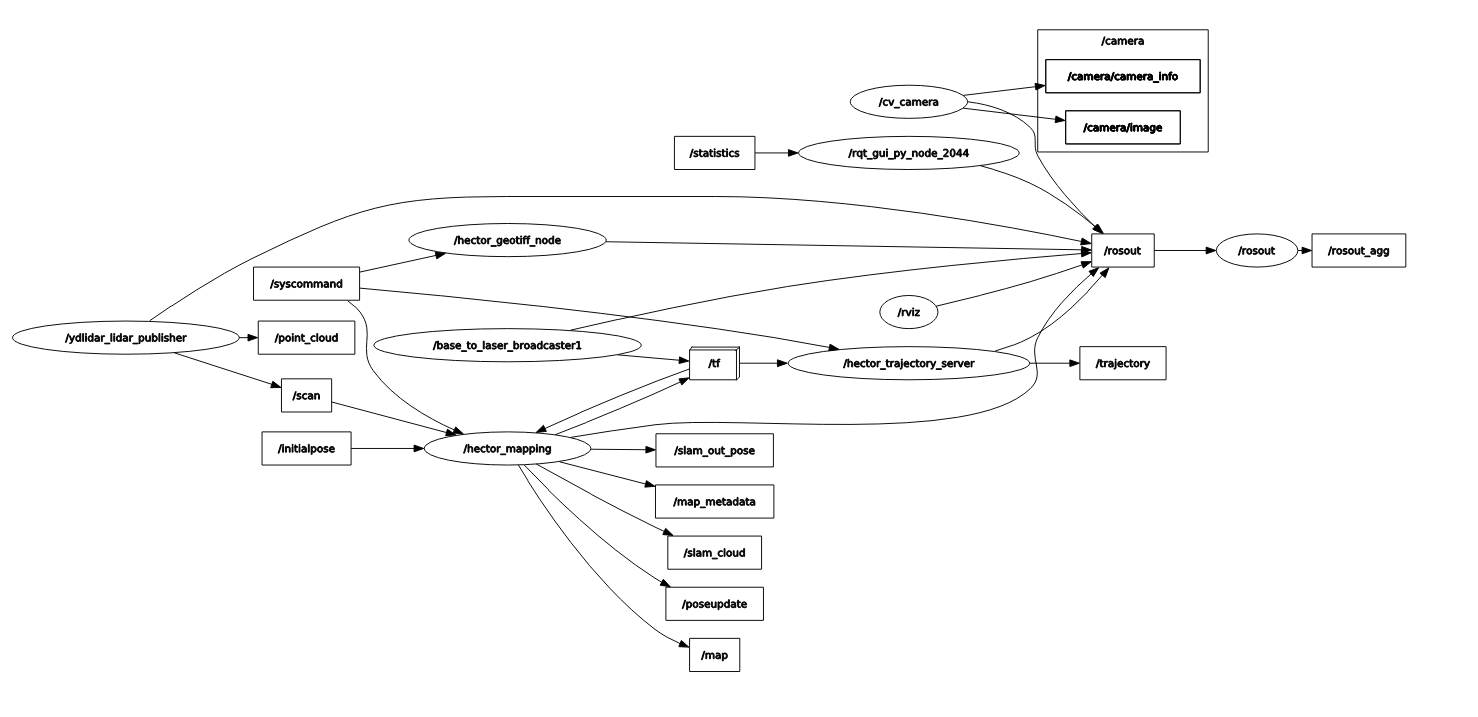

mapping도 정상적으로 진행된다. 이때의 node-topic 구조는 아래 rqt graph와 같다.

위 테스트 영상이다.

코드 시행에 문제가 없어 바로 준비된 M1 기체에 마운트하고 테스트를 진행하였다. 라이다는 마운트를 제작하지 않아 안전을 위해 바닥에 두었다.

카메라와 라이다 마운트 설계해서 장착할 예정이다.

끝.

반응형

'ROBOTICS > SpotMicro SAJOGI M2' 카테고리의 다른 글

| SAJOGI M2 : Frame&Circuit (0) | 2022.10.07 |

|---|---|

| SAJOGI M2: 부품 LIST (0) | 2022.10.07 |

댓글